新闻采集,能采集到国内新闻源文章,从文章的数据容量来说,远远的满足了网站对文章的需求,对文章有严苛要求的用户,对文章质量要求会更高,新闻采集的文章能追溯到15年前,很多搜索引擎因为服务器数据量庞大,都会逐步删除裁剪掉十年前的收录索引,因此采集几年十年前的文章发布,对蜘蛛来说,可视为原创。

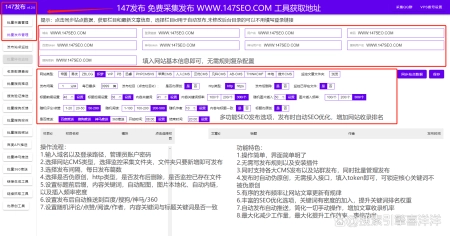

新闻采集在保存内容的时候,会自动生成时间戳txt,每个txt容量为50Kb,超出容量后会重新创建txt继续保存,这个功能是为网站或者站群设计,在大数据高频率运行读取的站群系统,如果TXT容量大,比如有的新手站长在放TXT的时候,文件几兆甚至有的几十兆,站群在读取txt数据的时候会造成cpu很高,甚至堵塞,新闻采集为了让网站和站群更高效率运行,小编建议大家在放置txt的时候文件大小不要超过50kb,不光是文章,关键词域名等文本txt也要严格按照这个文件大小。

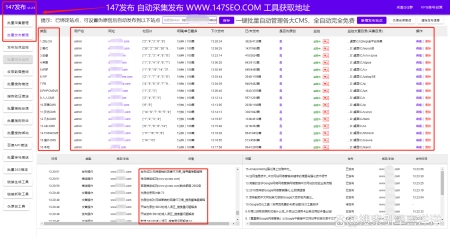

首次采集后,新闻采集会建立标题文本数据库,采集到的标题不会重复采集,新闻采集到的标题都是唯一的,绝不会重复。100万标题数据足够网站站长操作所有大数据站群,不论是做个人网站,或者内页站群,目录站群,新闻热词站群,新闻采集都能满足你的需求。

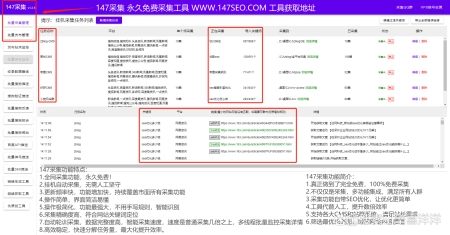

有了新闻采集的站长不再需要写采集规则了,因为不是所有人的都会写的,而且也不适合所有的站点。新闻采集还可以采集未收录的文章,一般的网站都是可以采集的。新闻采集6大功能:查收录,查页面状态、采未收录文章、采全部文章、判断原创度、设置文章字数。

采用了智能采集,不用编写采集规则(正则表达式)照样可以采集新闻内容。具有无限制采集功能,可采集远程图片到本地,并自动选择适合的图片来生成新闻内容缩略图。新闻采集所有新闻页面全部采用静态页面(.htm文件)生成,极大地提高了服务器的负载能力(根据需要也可以生成.aspx,shtml等类型文件)。可把RSS新闻采集成静态页面文件,新闻采集有集成企业级流量分析统计系统,让站长清楚网站访问情况。新闻采集所见所得的采集,智能记忆采集,不会重复采集,强大的实时采集,分页批量采集等。

新闻采集的实现原理,也在这里分享给大家,新闻采集通过python在获取html方面十分方便,寥寥数行代码就可以实现我们需要的功能。代码如下:

def getHtml(url):

page = urllib.urlopen(url)

html = page.read()

page.close()

return html

我们都知道html链接的标签是“a”,链接的属性是“href”,也就是要获得html中所有tag=a,attrs=href 值。查阅了资料,一开始我打算用HTMLParser,而且也写出来了。但是它有一个问题,就是遇到中文字符的时候无法处理。

class parser(HTMLParser.HTMLParser):

def handlestarttag(self, tag, attrs):

if tag ==a:

for attr, value in attrs:

if attr ==href:

print value

os.getcwd()#获得当前文件夹路径

os.path.sep#当前系统路径分隔符 windows下是“\”,linux下是“/”

#判断文件夹是否存在,如果不存在则新建一个文件夹

if os.path.exists(newsdir)== False:

os.makedirs(newsdir)

#str()用来将某个数字转为字符串

i =5

str(i)

评论0